人工智能之面部与身体动画迁移:技术演进与创新应用

一、技术原理与核心突破

面部与身体动画迁移技术通过深度学习模型,将参考视频中的表情、动作或姿态迁移到目标角色上,实现高效的内容生成。其核心突破包括:

- 表情与动作解耦:通过3D隐式空间(如X-Portrait 2的先进表情编码器)分离外观特征与动态信息,确保表情迁移时保留角色原始面貌,同时精准复刻微妙细节(如鼓腮、皱眉)。

- 跨模态协同:结合音频、姿态和环境信息(如EMAGE模型的音频-肢体动作联合训练),实现语音驱动的唇形同步(Playmate框架)或环境适应性角色动画(Animate Anyone 2)。

- 无训练迁移:创新性方法(如RoPECraft)直接利用旋转位置编码(RoPE)提取参考视频中的运动轨迹,无需额外模型训练即可完成动作迁移,显著降低技术门槛。

二、面部动画迁移的应用场景

- 影视与游戏制作

- 角色表情定制:通过静态肖像+表演视频生成动态角色(如X-Portrait 2),简化传统动作捕捉流程,适用于动画电影、虚拟偶像等内容创作。

- 唇形同步优化:Playmate框架基于音频生成精确的唇部运动序列,解决台词修改后的口型匹配问题,提升影视后期效率。

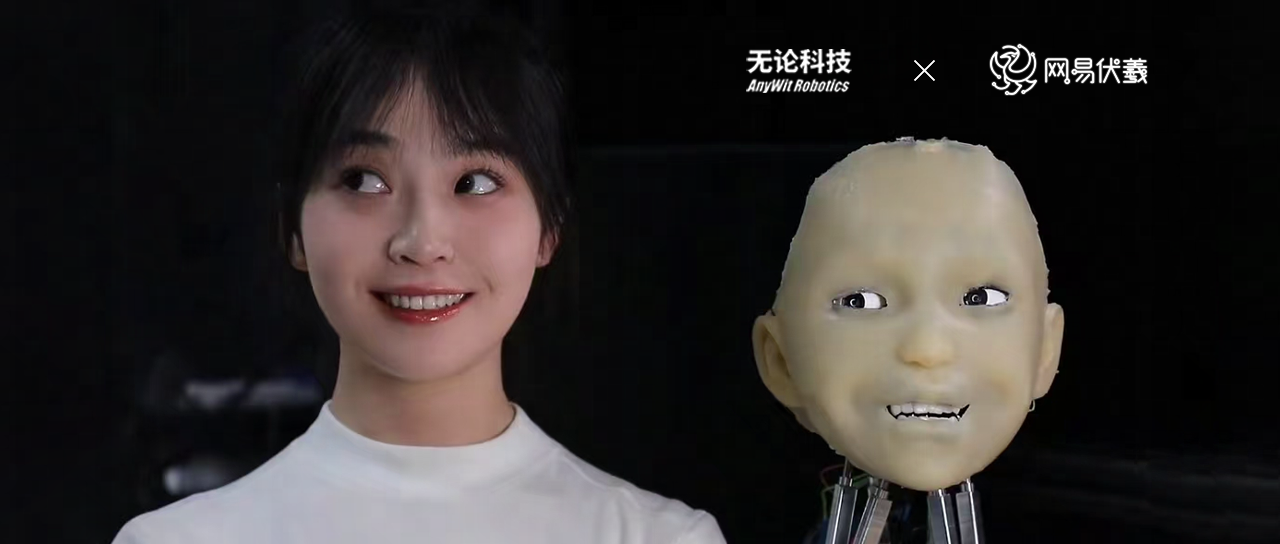

- 虚拟人交互

- 情感化虚拟代理:通过情感维度空间建模(如EMOPortraits的语音驱动表情迁移),使虚拟客服、教育助手等具备自然的情感表达能力。

- MetaHuman动画迁移:Unreal引擎与Maya间的面部动画工具(如metahuman_facial_transfer)支持跨平台资源复用,加速虚拟角色开发。

三、身体动画迁移的创新方向

- 跨物种与跨风格迁移

- FlexiAct技术:通过单张角色图像+参考视频实现真人、动漫角色甚至动物的动作迁移,无需复杂动捕设备,推动低成本动画制作。

- 层级变形木偶:Adobe提出的数据驱动方法(如“木偶动画”)通过2D网格分割和神经网络训练,生成逼真的角色姿势变化,适配手绘风格与3D模型。

- 环境与物体互动

- Animate Anyone 2:通过提取环境表示与物体特征(如空间混合技术),使角色动作与场景元素自然融合,例如抓取物体、避开障碍等复杂交互。

- BEAT2数据集:结合SMPLX肢体与FLAME面部参数,提供60小时高质量全身动作数据,为研究社区标准化3D动画生成奠定基础。

四、技术挑战与未来趋势

- 当前瓶颈

- 复杂动作泛化能力:动态环境(如舞蹈、武术)中动作迁移仍需依赖高精度骨骼跟踪,对非结构化场景适应性不足。

- 实时性与计算成本:高分辨率视频生成依赖强大算力,边缘设备部署仍需优化轻量化模型(如VQ-VAE压缩方案)。

- 发展方向

- 多模态融合增强:结合脑电波(EEG)或眼动追踪数据,实现更细腻的情感驱动动画(如焦虑时的颤抖动作)。

- 伦理与版权保护:开发数字水印技术,确保动画迁移内容的原创性与法律合规性(如防止未经授权的脸部替换)。

- 工业级自动化管线:构建从素材采集到动画生成的端到端流程(如自动标注关键帧、智能剪辑),降低专业团队依赖度。

五、结语

面部与身体动画迁移技术正在重塑数字内容创作范式,从传统动捕到AI驱动的“一键生成”,极大降低了动画制作的技术与成本门槛。随着跨模态学习、轻量化部署及伦理规范的完善,这些技术将在影视、教育、元宇宙等场景释放更大价值,推动人类与数字世界的深度融合。